Seit Jahrtausenden regt der Nachthimmel die Fantasie und den Forschergeist der Menschheit an. Die Astronomie beschäftigt sich mit der systematischen Beobachtung unseres Himmels und verfolgt dabei das Ziel, ein besseres Verständnis unserer Galaxie und dem uns umgebenden Weltall zu erlangen. Kosmische Strahlung und insbesondere Gammastrahlung, die zum Beispiel bei der Geburt eines neuen Sternes freigesetzt wird, liefern wichtige Hinweise auf die Vorgänge im Weltall. Wenn Gammastrahlung auf die Erdatmosphäre trifft, dann interagiert sie mit den sich dort befindlichen Atomen. Diese Interaktion setzt eine Kaskade von Wechselwirkungen in der Erdatmosphäre in Gang, die wie ein Regenschauer auf die Erdoberfläche fallen. Wir nehmen diesen Schauer als bläuliches, dem Polarlicht ähnelndes, Tscherenkowlicht wahr. Zur Untersuchung von Gammastrahlung werden in der erdgebundenen Gammaastronomie Teleskope auf entlegenen Bergen genutzt, um die physikalischen Wechselwirkungen zwischen hochenergetischer elektromagnetischer Strahlung und der Erdatmosphäre zu messen.

Die Zusammenarbeit zwischen PhysikerInnen und InformatikerInnen in der modernen Gammaastronomie ist bereits seit Langem etabliert und hat immer wieder zu bahnbrechenden Ergebnissen geführt. Die Astrophysik stellt ein spannendes Anwendungsgebiet für die Informatik dar, in welcher hohe Datenmengen in kurzer Zeit nachvollziehbar analysiert und verarbeitet werden müssen. InformatikerInnen können so zunächst konkrete Probleme für die PhysikerInnen lösen, um diese anschließend auf andere Problemstellungen zu verallgemeinern.

Auf dem Weg zur intelligenten Gammastrahlenklassifikation

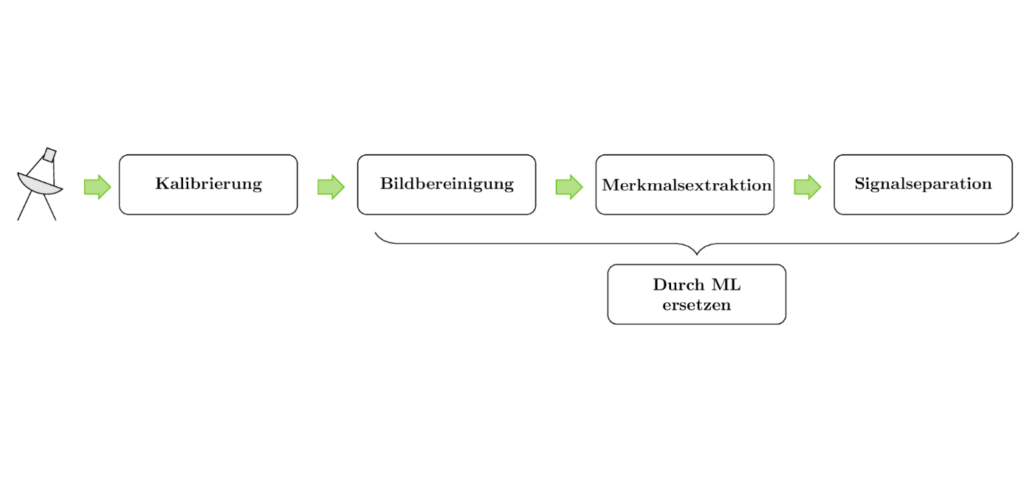

Die Forschergruppen des Lehrstuhls für Künstliche Intelligenz und des Lehrstuhls für Teilchenphysik an der TU Dortmund arbeiten schon seit Jahren im Rahmen des FACT Projektes zusammen. Das “First G-APD Cherenkov Telescope” (FACT) befindet sich auf dem Roque de los Muchachos auf La Palma (Spanien) und ist ein Teleskop zur Messung von Gammastrahlung. Das FACT Teleskop ist mit 1.440 Sensoren auf einer Fläche von etwa 9,5 Quadratmetern ausgestattet, die kontinuierlich den Himmel beobachten. Das Teleskop nimmt ca. 60 Messungen pro Sekunde auf, was insgesamt zu einer Datenrate von etwa 180 MB pro Sekunde führt. Dadurch ergeben sich pro Nacht ca. 5 TB an Rohdaten. Damit die Daten anschließend von PhysikerInnen untersucht werden können, müssen sie zunächst für das menschliche Auge vorverarbeitet werden. Diese Vorverarbeitungskette wurde in der interdisziplinären Zusammenarbeit zwischen PhysikerInnen und InformatikerInnen entwickelt und verfeinert. Grundsätzlich besteht eine solche Vorverarbeitungskette immer aus 4 Teilaufgaben, die sich im Rahmen des FACT Projekts in insgesamt 80 weitere Teilschritte aufgliedern:

Kalibrierung: Die 1.440 Sensoren des Teleskops reagieren empfindlich auf Umgebungsveränderungen, zum Beispiel Temperaturschwankungen. Daher müssen die Sensoren zunächst entsprechend eingestellt werden, um konsistente Messungen unter verschiedenen Bedingungen zu erlangen.

Bildbereinigung: Etwaige Fehlmessungen des Teleskops, zum Beispiel durch beschädigte Sensoren sowie verrauschte Messungen, werden korrigiert und gegebenenfalls entfernt, um die Mindestgüte der Messdaten zu gewährleisten.

Merkmalsextraktion: Nach der Kalibrierung und Bereinigung der Daten können diese als Bilder dargestellt werden. Aus diesen Bildern werden dann für die nachfolgende Klassifikation physikalische Kenngrößen, zum Beispiel die Größe oder Dauer eines Schauers, extrahiert.

Klassifikation: Nachdem die physikalischen Eigenschaften extrahiert wurden, kann es zu einer Bewertung der aktuellen Aufnahme kommen. Zunächst wird klassifiziert, ob der aufgenommene Schauer der Hintergrundstrahlung des Universums zuzuordnen ist, oder ob es sich dabei tatsächlich um einen Schauer handelt. Diese Aufgabe ist besonders anspruchsvoll, da lediglich eine von ca. 10.000 Aufnahmen einem Tscherenkowschauer zuzuordnen ist.

Die klassische Verarbeitungskette der Messdaten im Rahmen von FACT. Die letzten drei Schritte sollen nun durch ein einheitliches Modell ersetzt werden.

Zur Überwindung herausfordernder Infrastruktur

Das FACT Teleskop wird wie die meisten Teleskope auf entlegenen Bergen betrieben, um weitab von der Stadt einen ungetrübten Blick auf das Universum zu werfen. Dies bedeutet konkret, dass sowohl die Energie als auch der Platz für die Teleskophardware begrenzt ist und nur selten eine stabile Kommunikationsverbindung zum Rechenzentrum besteht. Tatsächlich werden einige Teleskope so betrieben, dass die Rohdaten zunächst auf Festplatten vor Ort gespeichert werden und dann periodisch im Abstand von ein paar Wochen durch Menschen abgeholt werden. Dieses Vorgehen verzögert die Datenanalyse und erschwert es, das Teleskop zeitnah auf spannende Ereignisse am Himmel auszurichten, da diese womöglich erst nach Wochen in den Daten entdeckt werden. Das Ziel der WissenschaftlerInnen von der TU Dortmund ist es daher, die Datenanalyse näher an das Teleskop zu bringen und im Idealfall eine (Vor-)Analyse der Daten in Echtzeit direkt am Teleskop auszuführen. Die Forschenden haben sich dazu entschieden, die langwierige Vorverarbeitungskette möglichst zu umgehen und durch ein einzelnes Klassifikationsmodell zu ersetzen. Hierzu muss die entwickelte Methode gut mit den realen, eventuell verrauschten Messungen ohne Vorverarbeitung umgehen können, gleichzeitig wenig Energie verbrauchen und mit der hohen Datenrate des FACT Teleskops Schritt halten können.

Gammastrahlenklassifikation mit Kleinen Geräten

Die Arbeit der Forschenden konzentrierte sich zunächst darauf, ein Modell zu finden, welches die hohe Datenrate am Teleskop verarbeiten kann und gleichzeitig robust gegenüber Fehlmessungen ist. Hierzu entschieden sich die Forschenden sogenannte Binarisierte Faltungsnetze (Binarized Convolutional Neural Networks) einzusetzen. Binarisierte Faltungsnetze sind eine besondere Form von Neuronalen Netzen zur Bilderkennung, die auf kleine, ressourcenarme Geräte spezialisiert sind. Klassische Neuronale Netze verwenden reellwertige Gewichte, die üblicherweise als Gleitkommazahlen gespeichert werden und so eine hohe Anzahl von Gleitkommaoperationen für die Klassifikation benötigen. Gleitkommaoperationen benötigen sehr viel Rechenzeit und damit viel Energie, was sie ungeeignet für FACT macht. Binarisierte Neuronale Netze hingegen verwenden nur zwei verschiedene Gewichte “-1” oder “+1”, welche als ein einzelnes Bit gespeichert werden können. Damit kommen Binarisierte Neuronale Netze ohne jegliche Gleitkommaoperationen aus. Dies reduziert Rechenzeit und Energiebedarf deutlich. In einer Reihe von über 1.100 Experimenten fanden die Forschenden schließlich ein passendes Modell, welches schnell genug für die Anwendung bei FACT ist und sich gleichzeitig robust gegenüber Fehlmessungen verhält. Das so gefundene Modell erreicht sowohl auf Simulationsdaten als auch auf realen Daten des Krebsnebels eine bessere Performanz und ist um mehrere Größenordnungen schneller als das klassische Vorgehen mit langwierigen Vorverarbeitungen.

Um das gefundene Modell anschließend am FACT Teleskop einzusetzen, haben die Forschenden ein Tool zur Erzeugung einer Hardwarebeschreibung für die Modelle entwickelt. Die Hardwarebeschreibung zeigt den Aufbau eines Computerchips, der spezifisch für das Ausführen des Modells gebaut wird. Diese Beschreibung wird dann zunächst in Software simuliert und getestet, um anschließend die entsprechende Hardware zu bauen. Zur Umsetzung der Hardware benutzen die Forscher sogenannte Field Programmable Gate Arrays (FPGAs), welche beliebige Hardwarebeschreibungen akzeptieren und umsetzen. FPGAs lassen sich leicht in die Kamerasensorik des Teleskops integrieren und anschließend nachträglich (“in the Field”) mit der passenden Beschreibung programmieren. Durch dieses Vorgehen ist es möglich, einen Großteil der Datenanalyse bereits in der Kamerasensorik einzubetten, wobei sie flexibel nachträglich mit neuen Beschreibungen ausgetauscht werden kann. Die Analyse kann so parallel in Echtzeit zur eigentlichen Messung erfolgen.

Die Arbeit der Forschenden liefert einen wichtigen Baustein in der Analyse astronomischer Daten und damit dem Verständnis unseres Universums. Durch die verkürzte Analysekette können die Teleskope in Echtzeit auf Ereignisse ausgerichtet werden und die Daten können sofort von PhysikerInnen analysiert werden. Die Tragweite dieser Arbeit geht jedoch noch über die Physik hinaus und kann auch in anderen Bereichen unseres Alltages Anwendung finden. Denn: Die zugrundeliegende Technik ist weitgehend unabhängig von den Messdaten eines Teleskops. Sie lässt sich zum Beispiel genauso auf medizinische Daten, wie Röntgenbilder oder Bilder einer Magnetresonanztomographie (MRT) anwenden, sodass Patienten eine sofortige Rückmeldung zu Untersuchungsergebnissen erhalten können.

Mehr Informationen im zugehörigen Paper:

On-Site Gamma-Hadron Separation with Deep Learning on FPGAs

Sebastian Buschjäger, Lukas Pfahler, Jens Buss, Katharina Morik & Wolfgang Rhode. European Conference on Machine Learning and Principles and Practice of Knowledge Discovery in Databases (ECML PKDD), 2020 (Veröffentlichung noch ausstehend, Präsentation).