Die moderne klinische KI steht vor einem grundlegenden Spannungsfeld: Modelle erfordern große, vielfältige Datensätze, doch Patientendaten können nicht einfach institutionsübergreifend gepoolt werden. Multi-institutionelles Lernen ist in der medizinischen Bildgebung, Onkologie, Radiologie und EHR-basierten Risikovorhersage unerlässlich, wo Datensätze einzelner Standorte oft nicht ausreichend vielfältig oder statistisch aussagekräftig sind. Doch regulatorische Rahmenwerke wie die EU-Datenschutz-Grundverordnung (DSGVO) stufen Gesundheitsinformationen als besondere Kategorie personenbezogener Daten ein und schreiben strenge Anforderungen an Datenminimierung und Vertraulichkeit vor.

Infolgedessen ist ein zentralisiertes Modelltraining in realen Krankenhausnetzwerken häufig nicht durchführbar. Das Federated Learning im Gesundheitswesen zielt darauf ab, diesen Konflikt zu lösen: Modelle werden lokal in jeder Einrichtung trainiert, und es werden nur Modellaktualisierungen ausgetauscht, nicht jedoch sensible Patientendaten. Neuere Forschungsergebnisse zeigen jedoch, dass Datenschutzrisiken nicht einfach verschwinden, nur weil die Rohdaten lokal bleiben. Dies wirft eine naheliegende Frage auf: Wenn die Weitergabe von Rohdaten zu aufschlussreich ist und die Weitergabe von Modellparametern immer noch zu Informationslecks führen kann, wie wenig Informationen sind dann tatsächlich für eine sinnvolle Zusammenarbeit erforderlich?

Wenn Datenschutz mehr sein soll als ein nachträglicher Zusatz, müssen wir verstehen, wo in klassischen föderierten Protokollen Informationslecks entstehen.

Datenschutzbeschränkungen beim Federated Learning im Gesundheitswesen

In seiner kanonischen Form aggregiert das Federated Learning (z. B. FedAvg) Modellparameter oder Gradienten über alle teilnehmenden Institutionen hinweg. Während rohe medizinische Bilder oder strukturierte Patientenakten vor Ort verbleiben, können gemeinsame Aktualisierungen latente Informationen über die Trainingsdaten kodieren.

Es wurden mehrere Angriffsklassen demonstriert:

- Angriffe zur Ableitung der Mitgliedschaft, bei denen versucht wird, festzustellen, ob ein bestimmter Patientenfalle zum Modelltraining beigetragen hat

- Gradienteninversionsangriffe, die in der Lage sind, Eingabemerkmale aus gemeinsam genutzten Gradienten zu rekonstruieren

- Eigenschaftsinferenzangriffe, die statistische Merkmale lokaler Datensätze extrahieren

Beim Federated Learning im Gesundheitswesen sind diese Schwachstellen besonders folgenschwer. MRT-Scans, Pathologie-Objektträger und elektronische Gesundheitsakten enthalten gesetzlich geschützte und ethisch sensible Informationen. Selbst indirekte Datenlecks durch Modellaktualisierungen können zu Compliance-Problemen im Rahmen der DSGVO und vergleichbarer Regulierungssysteme führen.

Differential Privacy Mechanismen können diese Risiken mindern, indem sie Rauschen in Aktualisierungen einfügen. Dies führt jedoch zu Leistungseinbußen. In diagnostischen KI-Systemen wirkt sich eine verringerte Sensitivität oder Spezifität direkt auf die klinische Zuverlässigkeit aus. Wichtig ist, dass Differential Privacy zwar auf viele Federated Protocols angewendet werden kann, ihre praktische Wirkung jedoch davon abhängt, wie Informationen aggregiert werden. Bei der Parametermittelung breitet sich das eingefügte Rauschen direkt durch hochdimensionale Aktualisierungen aus. Im Gegensatz dazu ist die konsensbasierte Aggregation über diskrete Labels von Natur aus robuster gegenüber solchen Störungen, sodass formale Garantien mit vergleichsweise geringeren empirischen Leistungseinbußen hinzugefügt werden können. Mit anderen Worten: Datenschutzgarantien und Vorhersageleistung stehen bei der konsensbasierten Zusammenarbeit weniger im Widerspruch zueinander als bei der Parametermittelung. In der Praxis erwies sich dies als folgenreicher als erwartet. Während die differentielle Privatsphäre bei der Parametermittelung oft zu erheblichen Genauigkeitsverlusten führt, wenn bedeutungsvolles Rauschen hinzugefügt wird, blieb die Leistung des Konsensmechanismus nahezu unverändert, sodass formale Garantien zu vergleichsweise geringen zusätzlichen Kosten effektiv bereitgestellt werden konnten.

Ein alternativer Ansatz, die verteilte Destillation, ersetzt die Parameterfreigabe durch den Austausch von Soft-Labels. Die teilnehmenden Institutionen teilen sich die posterioren Wahrscheinlichkeitsverteilungen eines öffentlichen Datensatzes. Während die Kommunikationskosten sinken, kodieren Soft-Labels weiterhin reichhaltige Informationen zur Entscheidungsgrenze und kalibrierte Unsicherheit.

Dies führt zu einer noch grundlegenderen Frage:

Wie viele Informationen müssen Institutionen mindestens austauschen, um effektiv zusammenarbeiten zu können?

Federated Co-Training: Nur Hard Labels teilen

Eine grundsätzliche Antwort auf diese Frage geben Abourayya et al. (2023) in unserer Arbeit „Little is Enough: Boosting Privacy by Sharing Only Hard Labels in Federated Semi-Supervised Learning”. Wir stellen Federated Co-Training (FedCT) vor, ein Protokoll, das die Parameteraggregation durch konsensbasierte Pseudokennzeichnung ersetzt.

Anstatt Gradienten oder Wahrscheinlichkeitsverteilungen auszutauschen, führt jede teilnehmende Einrichtung folgende Schritte durch:

- Trainieren eines lokalen Modells anhand privater klinischer Daten.

- Generieren von Hard Labels (endgültige Klassenzuweisungen) für Instanzen in einem gemeinsamen öffentlichen Datensatz.

- Übertragen nur dieser diskreten Labels an einen zentralen Server.

Der Server aggregiert die Vorhersagen in der Regel per Mehrheitsbeschluss und verteilt die konsensbasierten Pseudolabels für das anschließende lokale Training neu.

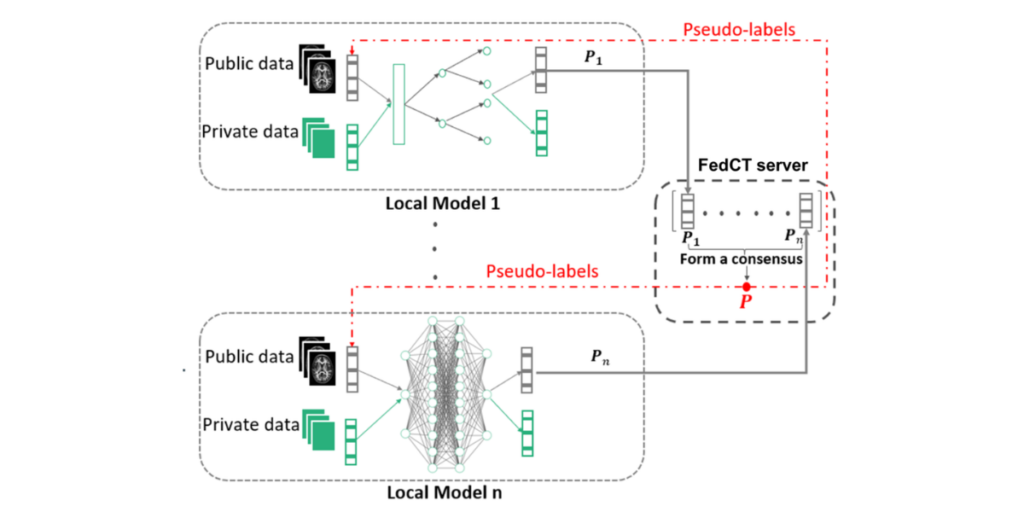

Dieser Arbeitsablauf ist in Abbildung 1 dargestellt.

Abbildung 1: Workflow für Federated Co-Training © Abourayya et al. (2023)

Lokale Modelle, die anhand von Daten privater Krankenhäuser trainiert wurden, generieren Vorhersagen zu gemeinsam genutzten öffentlichen Daten. Nur harte Labels werden an den FedCT-Server übertragen, wo konsensbasierte Pseudo-Labels gebildet und neu verteilt werden.

Der konzeptionelle Wandel ist einfach: Zusammenarbeit erfordert keine Weitergabe von Modellinterna mehr. Weiche Labels kodieren kalibrierte Unsicherheit und die Ähnlichkeitsstruktur zwischen Klassen. Harte Labels reduzieren diese Darstellung auf ein einziges kategorisches Ergebnis. Aus informationstheoretischer Sicht verringert die Reduzierung von Wahrscheinlichkeitsverteilungen auf definitive Klassenentscheidungen die Menge der übertragenen Informationen und schränkt die potenzielle Angriffsfläche ein.

Für das Federated Learning im Gesundheitswesen stärkt diese Reduzierung der gemeinsam genutzten Informationen direkt die Widerstandsfähigkeit des Datenschutzes.

Auf den ersten Blick könnte man erwarten, dass die Weitergabe von weniger Informationen zwangsläufig die Modellleistung verringert. Überraschenderweise haben wir das Gegenteil beobachtet: Das konsensbasierte Protokoll entspricht dem klassischen föderierten Mittelwert und konvergiert oft schneller, was darauf hindeutet, dass Mehrheitsentscheidungen frühzeitige Trainingsstörungen wirksamer dämpfen können als Parametermittelungen.

Empirische Bewertung des Datenschutzes

Die Privatsphäre im FedCT-Framework wird anhand einer Schwachstellenmetrik (VUL) bewertet, die aus den Erfolgsraten von Mitgliedschafts-Inferenzangriffen abgeleitet wird. Ein VUL-Wert von 0,5 entspricht einer zufälligen Vermutung und somit einer optimalen Privatsphäre.

Abbildung 2 veranschaulicht den Kompromiss zwischen Privatsphäre und Nutzen bei mehreren föderierten Strategien.

Abbildung 2: Testgenauigkeit vs. Datenschutzanfälligkeit, wobei die Anfälligkeit als Erfolgswahrscheinlichkeit eines Angriffs zur Ableitung der Mitgliedschaft gemessen wird. © Abourayya et al. (2023)

Das Diagramm vergleicht FedCT, DP-FedCT, FedAvg, DP-FedAvg und Distributed Distillation (DD). Niedrigere VUL-Werte weisen auf einen höheren Datenschutz hin.

Empirisch gesehen erreicht FedCT VUL-Werte nahe 0,5, was bedeutet, dass Angriffe zur Ableitung von Mitgliedschaften fast wie zufällige Vermutungen funktionieren, während gleichzeitig eine wettbewerbsfähige Testgenauigkeit beibehalten wird. Im Gegensatz dazu weisen klassische föderierte Mittelwertbildung und Soft-Label-Ansätze eine höhere Anfälligkeit für Datenschutzverletzungen auf.

In klinischen Umgebungen mit hohem Risiko, in denen die behördliche Kontrolle erheblich ist, sind empirische Belege dafür, dass Angriffe nicht besser als zufällige Vermutungen sind, nicht nur ein weiterer Beweis, sondern entscheidend.

Leistung bei Aufgaben der klinischen Bildgebung

Die Diagnoseleistung bleibt für jedes klinische KI-System von zentraler Bedeutung. Wir haben FedCT anhand von Benchmark-Datensätzen sowie medizinischen Bildgebungsaufgaben bewertet, darunter die Klassifizierung von Lungenentzündungen und die Erkennung von Hirntumoren mittels MRT.

Tabelle 1 zeigt die Testgenauigkeit (ACC) und die Privatsphärenverletzlichkeit (VUL) bei homogenen Client-Verteilungen (m = 5).

Tabelle 1: Testgenauigkeit (ACC) und Datenschutzanfälligkeit (VUL) (Eine geringere VUL bedeutet einen stärkeren Datenschutz.). © Abourayya et al. (2023)

Sowohl bei Lungenentzündungs- als auch bei MRT-Aufgaben erreicht FedCT eine mit FedAvg vergleichbare Genauigkeit und verbessert gleichzeitig die Datenschutzmetriken erheblich.

Diese Ergebnisse deuten darauf hin, dass beim Federated Learning im Gesundheitswesen Datenschutzgewinne nicht auf Kosten der klinisch relevanten Vorhersageleistung gehen müssen.

Robustheit bei heterogenen Krankenhausdaten

Gesundheitsdaten sind von Natur aus heterogen. Unterschiede bei Bildgebungsgeräten, Erfassungsprotokollen, Patientendemografien und institutionellen Praktiken führen zu nicht-iid-Verteilungen zwischen den Standorten. Diese Heterogenität stellt eine Herausforderung für die klassische Parameteraggregation dar. FedCT mindert extreme lokale Verzerrungen durch Konsensaggregation. Die Mehrheitsentscheidung glättet idiosynkratische Entscheidungsgrenzen, ohne dass eine Angleichung der internen Modelldarstellungen erforderlich ist. Empirische Bewertungen zeigen, dass FedCT unter heterogenen Client-Verteilungen eine wettbewerbsfähige Genauigkeit beibehält und gleichzeitig seinen Datenschutzvorteil bewahrt.

Interpretierbarkeit und Modellflexibilität

Interpretierbarkeit ist eine Kernanforderung in der klinischen KI. Regulatorische Rahmenbedingungen verlangen zunehmend Transparenz und Überprüfbarkeit automatisierter Entscheidungssysteme.

Das standardmäßige Federated Learning geht von homogenen neuronalen Netzwerkarchitekturen aus, um eine Parametermittelung zu ermöglichen. Dies schränkt die Verwendung von inhärent interpretierbaren Modellen wie Entscheidungsbäumen, Zufallswäldern und Regelensembles ein. FedCT entkoppelt die Zusammenarbeit von der Parametermittelung. Da nur Vorhersagen ausgetauscht werden, können die teilnehmenden Institutionen heterogene Modellklassen verwenden, einschließlich solcher interpretierbarer Modelle, die bei strukturierten klinischen Vorhersageaufgaben oft bevorzugt werden. Für das Federated Learning im Gesundheitswesen erweitert diese architektonische Flexibilität die Anwendbarkeit in Umgebungen, die Erklärbarkeit erfordern.

Kommunikationseffizienz

Große neuronale Architekturen können Millionen von Parametern enthalten. In multi-institutionellen Krankenhausnetzwerken verursacht die wiederholte Übertragung solcher Aktualisierungen einen erheblichen Kommunikationsaufwand.

FedCT reduziert das Kommunikationsvolumen im Vergleich zu FedAvg um bis zu zwei Größenordnungen, da nur diskrete Klassenbezeichnungen ausgetauscht werden.

Diese Effizienz verbessert die Skalierbarkeit in internationalen Forschungskonsortien und ressourcenbeschränkten klinischen Umgebungen und stärkt damit die Praktikabilität des Federated Learning im Gesundheitswesen.

Erweiterung auf klinische Sprachmodelle

KI im Gesundheitswesen nutzt zunehmend große Sprachmodelle (LLMs) für Aufgaben wie die Zusammenfassung klinischer Notizen, Phänotypisierung und automatisierte Kodierung.

Vorläufige Untersuchungen deuten darauf hin, dass konsensbasierte Zusammenarbeit über Bildgebungs- und strukturierte Vorhersageaufgaben hinaus auf generative Modelle ausgeweitet werden kann. Der Pseudo-Labeling-Mechanismus liefert ein stabiles Kollaborationssignal, ohne dass Gradientenaktualisierungen aus sensiblen Textdaten weitergegeben werden müssen.

Dies deutet darauf hin, dass Protokolle mit minimalen Informationen über Bildgebung und strukturierte Vorhersagen hinaus auf sprachbasierte klinische KI verallgemeinert werden können.

Offene Fragen und Zukunftsperspektiven

Obwohl FedCT den Datenschutz beim Federated Learning im Gesundheitswesen erheblich stärkt, bleiben einige Fragen offen:

- Wie empfindlich reagiert die Leistung auf die Repräsentativität des gemeinsam genutzten öffentlichen Datensatzes?

- Können synthetische oder generative Daten als robuste öffentliche Anker dienen?

- Wie kann die Konsensaggregation gegen feindliche Manipulationen von Labels gestärkt werden?

- Was sind die theoretischen Datenschutzgrenzen bei extremer Heterogenität?

Zukünftige Arbeiten an der Schnittstelle von Federated Learning, semi-überwachtem Lernen und datenschutzkonformen maschinellem Lernen werden diese Fragen weiter klären.

Fazit: Minimale Informationen als klinisches Designprinzip

Federated Learning im Gesundheitswesen zielt darauf ab, eine Zusammenarbeit zu ermöglichen, ohne Patientendaten zu zentralisieren. Die gemeinsame Nutzung von Parametern und der Austausch von Soft-Labels bergen jedoch weiterhin Risiken für die Privatsphäre.

Federated Co-Training zeigt, dass der Austausch von Hard-Labels die für potenzielle Angreifer verfügbaren Informationen reduziert und gleichzeitig eine wettbewerbsfähige Diagnoseleistung gewährleistet. In diesem Sinne verlässt es die ursprüngliche Idee des Federated Learning nicht – es führt sie konsequent zu Ende. Durch die Minimierung der ausgetauschten Informationen entspricht der Ansatz den regulatorischen Grundsätzen der Datenminimierung und des Datenschutzes by Design.

Für die Forschung im Bereich Life Sciences & Health bietet dieses Paradigma:

- Stärkere empirische Datenschutzgarantien

- Kompatibilität mit interpretierbaren Modellen

- Robustheit bei heterogenen Krankenhausdaten

- Signifikante Kommunikationseffizienz

Die Verbesserung des Federated Learning im Gesundheitswesen erfordert nicht unbedingt immer komplexere Schutzmechanismen, die auf bestehende Protokolle aufgesetzt werden. Stattdessen muss grundlegend hinterfragt werden, welche Informationen überhaupt jemals ausgetauscht werden mussten.