Aufbauend auf Dr. Sebastian Buschjägers Blogbeitrag „Lernen aus Datenströmen: Grundlagen des Stream Learning“ untersucht dieser zweite Artikel unserer Stream-Mining-Reihe, wie heterogene Online-Ensembles wie HEROS präzises, ressourceneffizientes Lernen unter Konzeptdrift ermöglichen.

Warum ein einzelnes Modell nicht immer ausreicht

Sich bei Vorhersagen auf ein einzelnes Machine-Learning-Modell zu verlassen, ist nicht immer der zuverlässigste Ansatz. Mehrere Meinungen können die Entscheidungsfindung verbessern und oft zu genaueren und vertrauenswürdigeren Ergebnissen führen. Dieser Ansatz wird als Ensemble-Lernen bezeichnet.

Die Grundidee des Ensemble-Lernens besteht darin, die Ausgaben von zwei oder mehr Modellen zu einem einzigen, verbesserten Vorhersagewert zusammenzuführen. Es gibt viele Möglichkeiten, die Ergebnisse einzelner Modelle innerhalb eines Ensembles zu kombinieren. Zu den einfachsten Ansätzen gehören das Mitteln ihrer Vorhersagen oder die Auswahl des für eine Eingabe zuversichtlichsten Modells. Allerdings sind Ensembles zwar leistungssteigernd, bringen aber auch Kosten mit sich.

Insbesondere im Datenstrom-Lernen und in Echtzeitszenarien spielt die Verarbeitungszeit eine entscheidende Rolle. Bevor wir uns also mit der Reduzierung der Kosten befassen, schauen wir zunächst darauf, wie wir die Diversität innerhalb des Ensembles erhöhen können.

Heterogenität in Ensembles nutzen

Ein Ensemble wird besonders leistungsfähig, wenn seine Mitglieder vielfältig sind. Diversität (oder Heterogenität) sorgt dafür, dass Modelle unterschiedliche Arten von Fehlern machen, die sich bei der Kombination gegenseitig ausgleichen können und so die Gesamtrobustheit erhöhen.

Dennoch bleibt die Konfiguration von Hyperparametern für Modelle, die auf kontinuierlich wechselnden, bislang ungesehenen Daten arbeiten, eine große Herausforderung. Zwar können adaptive Modelle mit Concept Drift (Veränderung der zugrunde liegenden Datenverteilung) umgehen, ihre Hyperparameter müssen jedoch häufig weiterhin manuell abgestimmt werden. Um dies zu überwinden, führt Heterogeneous Online Ensembles (HEROS) einen neuartigen Ansatz ein: Unter Ressourcenbeschränkungen wird aus einem Pool von Modellen, die mit unterschiedlichen Hyperparameter-Einstellungen initialisiert wurden, eine Teilmenge ausgewählt und trainiert. Diese eingebaute Diversität macht eine manuelle Hyperparameter-Abstimmung überflüssig.

Das HEROS-Framework

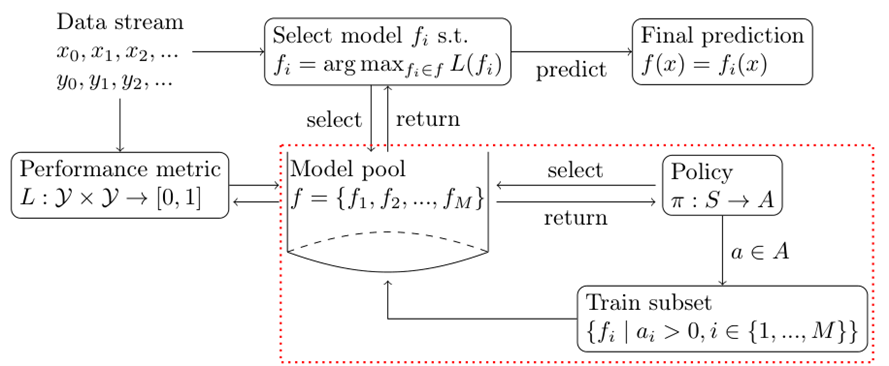

HEROS ist ein Framework, das dafür entwickelt wurde, ein Ensemble von Modellen auf Datenströmen zu trainieren und dabei unter Ressourcenbeschränkungen zu arbeiten. In diesem Setting bestimmt eine Strategie (Policy), welches Ensemble-Mitglied mit jeder neu eintreffenden Instanz aus dem Strom aktualisiert (d. h. trainiert) werden soll. Wie in Abbildung 2 dargestellt, hebt die schematische Übersicht diesen Prozess hervor, wobei der rot gestrichelte Bereich die Komponente kennzeichnet, auf die wir uns konzentrieren.

Sei $L:Y×Y→[0,1]$ ein normalisiertes Leistungsmaß (z.B. Accuracy), das wir maximieren möchten. Für jede eingehende Instanz wählt das Framework das Modell $f_i$ mit der höchsten Vorhersagegenauigkeit aus, um die endgültige Vorhersage zu erzeugen. Gleichzeitig entscheidet die Policy dynamisch, welche $k$ Modelle auf jeder Instanz trainiert werden sollen, damit alle Modelle im Ensemble (bezeichnet als der Pool $f=f_1, f_2, … f_m)$ aktuell bleiben.

Aber wie entscheiden wir, welche Modelle im Ensemble trainiert werden sollen?

Ein einfacher Ausgangspunkt besteht darin, die $k$ einzelnen Modelle auszuwählen mit

- Perform-best: Modelle $f_i$ werden anhand ihres höchsten Leistungsmaßes $L(f_i)$ ausgewählt,

- Perform-worse: Fokussierung auf Modelle mit aktuell niedriger Leistung $L(f_i)$, um ihnen die Möglichkeit zu geben, sich anzupassen und zu verbessern,

- Cheapest: Auswahl nach geringstem Ressourcenverbrauch,

- Expensive: Auswahl nach hohem Ressourcenaufwand, oder

- CAND, eingeführt von Gunasekara et al., kombiniert diese Ideen, indem die Hälfte der Modelle anhand ihrer besten Leistung und die andere Hälfte zufällig ausgewählt wird.

Da Rechenressourcen wie Verarbeitungsleistung und Energie kostspielig sind, wollen wir den Ressourcenverbrauch minimieren und gleichzeitig eine starke Vorhersagegenauigkeit aufrechterhalten. Mit der Veränderung der zugrunde liegenden Verteilung der Daten bleibt jedoch nicht jedes Modell für das aktuelle Konzept geeignet. Idealerweise priorisieren wir das Training für Ensemble-Mitglieder, die:

- aktuell eine hohe Vorhersagegenauigkeit zeigen und

- nur wenige Ressourcen für ein Update benötigen.

Das Ausbalancieren dieser beiden Ziele führt zu einem Mehrziel-Optimierungsproblem, das rechnerisch sehr aufwendig ist, wenn es exakt gelöst werden soll. Um diese Komplexität zu handhaben, führt HEROS die $\zeta$-Policy ein.

Grünes Lernen durch Ressourceneinsparung

Anstatt sich ausschließlich auf die Maximierung der Vorhersageleistung zu konzentrieren, verwendet HEROS eine einfache, aber effektive Strategie, die sogenannte $\zeta$-Policy. Diese Policy wählt iterativ $k$ Modelle aus auf Basis von:

- niedrigen Ressourcenkosten $Y_i$ und

- akzeptabler Vorhersagegenauigkeit, d.h. die Leistung des Modells darf nicht schlechter sein als $1−\zeta$ mal die des besten noch nicht ausgewählten Modells.

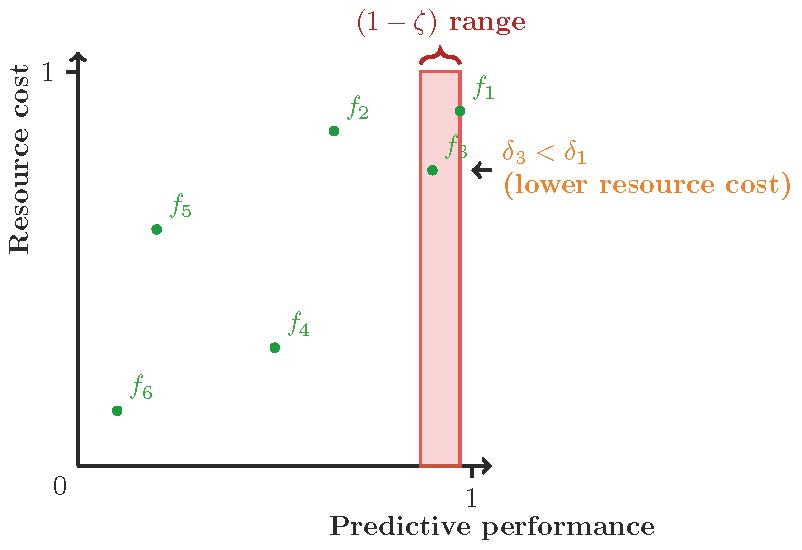

Zum Beispiel hat in Abbildung 2 $f_i$ die höchste Vorhersagegenauigkeit, aber $f_3$ liegt mit der Leistung innerhalb von $(1-\zeta) L(f_1)$ und benötigt weniger Ressourcen für das Training. In diesem Fall bevorzugt die Policy $f_3$ über $f_1$.

Um jedoch den verbleibenden Zustandsraum zu erkunden, wird mit einer Wahrscheinlichkeit von $\epsilon$ mithilfe der $\epsilon$-Greedy-Strategie eine zufällige Kombination von $k$ Modellen ausgewählt.

Soweit, so gut – aber vielleicht kommt jetzt die Frage auf: Wie messen wir eigentlich Ressourcen während der Laufzeit? Schauen wir uns dazu einige Möglichkeiten an:

- Vordefinierte und feste Ressourcenkosten: z.B. die Anzahl der Hidden Nodes und Layers in einem neuronalen Netz oder die maximale Baumtiefe eines Hoeffding-Baums,

- Trainingszeit: Messung der durchschnittlichen Zeit (über vergangene Instanzen, gespeichert in einem Window), die für das Training einer einzelnen Instanz benötigt wird,

- Speicherverbrauch: analog zur Trainingszeit.

Reaktion auf Drift

Wenn sich die Datenverteilung verändert, können Modelle, die zuvor gut funktioniert haben, an Wirksamkeit verlieren. HEROS aktualisiert die geschätzte Vorhersageleistung jedes Modells kontinuierlich, sodass die Policies schnell auf Concept Drift reagieren können.

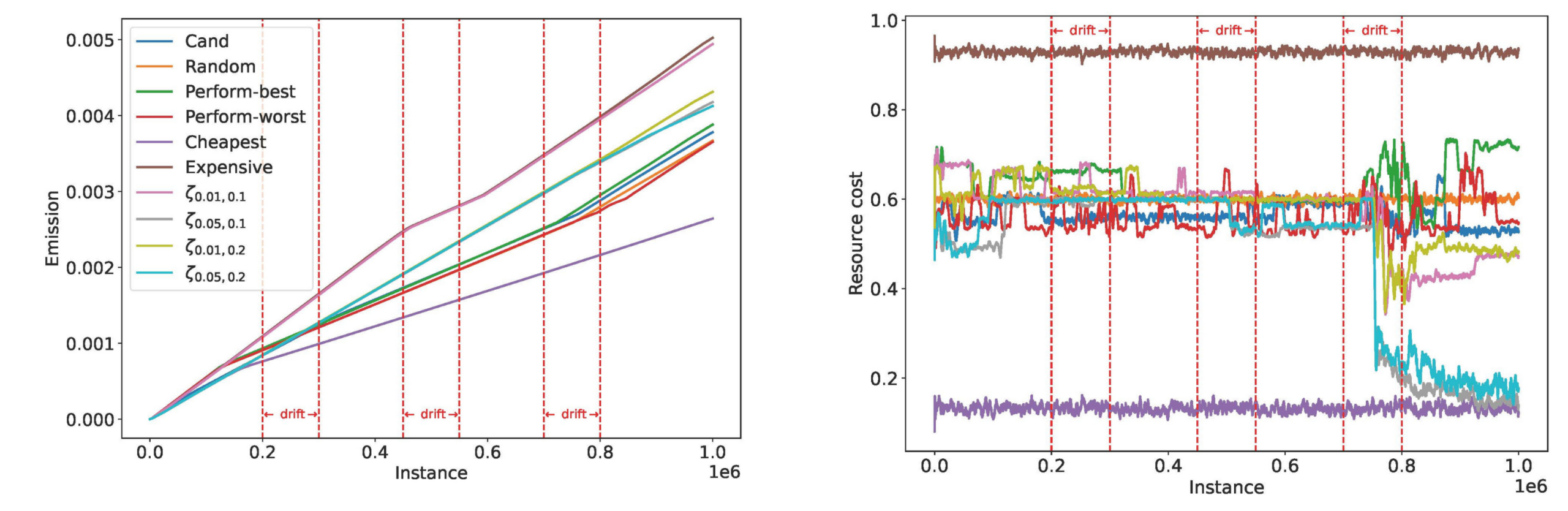

Die Anpassungsfähigkeit zeigt sich in den Evaluierungsergebnissen:

In Abbildung 3(a) wird die Bedeutung der Policy-Namen deutlich: Cheapest und Expensive spiegeln die Spannweite der Ressourcenkosten wider, während kurzfristige Einbrüche in den CO2-Emissionen rund um die Drifts auf vorübergehende Anpassungen hinweisen. In Abbildung 3(b) verschiebt sich der Ressourcenverbrauch unter der $\zeta$-Policy (rosa, graue, grüne und blaue Linien) infolge eines graduellen Drifts. Nach dem Drift wird eine neue Teilmenge von Modellen für das Training ausgewählt, da andere Modelle auf das neue Konzept besser zu reagieren beginnen.

Über 11 Benchmark-Datensätze hinweg (weitere Details im Paper) treibt HEROS den Stand der Technik konsistent voran und übertrifft in mehreren Fällen führende Online-Ensembles wie Adaptive Random Forest, Streaming Random Patches und Shrub Ensembles.

Werfen wir nun einen kurzen Blick auf die theoretischen Grundlagen.

Einige theoretische Grundlagen

Das asymptotische Verhalten verschiedener Policies wurde mithilfe eines stochastischen Modells analysiert (weitere Details im Paper). Gegeben ein Pool der Größe $M$, aus dem gemäß einer Policy $k$ Modelle ausgewählt werden, haben wir die folgenden Theoreme hergeleitet:

- Die durchschnittliche Vorhersagegenauigkeit (mit Wahrscheinlichkeit $1-\epsilon$), die durch Anwendung der $\zeta$-Policy erreicht wird, ist höher als diejenige, die durch Anwendung der CAND-Policy erreicht wird, wenn $M \to ∞$ $M \to ∞$ und anschließend $k \to ∞$.

- Gleichzeitig ist der durchschnittliche Ressourcenverbrauch (mit Wahrscheinlichkeit $1- \epsilon$), der durch Anwendung der -Policy erreicht wird, geringer als derjenige der CAND-Policy, wenn M und anschließend $k$.

Zentrale Erkenntnisse: Wenn Modelle nicht zufällig ausgewählt werden (Exploitation (d.h. Ausnutzung der aktuell besten bekannten Modelle, anstatt neue Alternativen zu erkunden) mit Wahrscheinlichkeit $\epsilon \ll 1$), erzielt die $\zeta$-Policy für kleinere $\zeta$ eine höhere durchschnittliche Vorhersageleistung, während die durchschnittlichen Ressourcenkosten im Vergleich zu CAND geringer sind. Darüber hinaus wird im Paper gezeigt, dass die Ressourcenkosten unter der $\zeta$-Policy asymptotisch niedriger sind als unter perform-best, während gleichzeitig Modelle mit höchstens $\zeta$ schlechterer Vorhersagegenauigkeit genutzt werden.

Zusammenfassung

Wenn nur wenig über den aktuellen Datenstrom bekannt ist oder Hyperparameter nicht im Voraus abgestimmt werden können, bietet HEROS eine ideale Lösung. Abschließend lassen sich die wichtigsten Vorteile von HEROS wie folgt zusammenfassen:

- Keine Hyperparameter-Abstimmung dank des heterogenen Designs

- Effiziente Ressourcennutzung während des Trainings

- Schnelle Anpassung an Concept Drift

- Flexible Integration verschiedener Policies

- … und vieles mehr!

Du kannst HEROS in Aktion in der neuesten Version der Open-Source-Bibliothek MOA ausprobieren!

Literatur

- Kirsten Köbschall, Sebastian Buschjäger, Raphael Fischer, Lisa Hartung, and Stefan Kramer. Lift What You Can: Green Online Learning with Heterogeneous Ensembles. 2025. arXiv: 2509.18962

- Nuwan Gunasekara, Heitor Murilo Gomes, Bernhard Pfahringer, and Albert Bifet. 2022. Online Hyperparameter Optimization for Streaming Neural Networks. In 2022 International Joint Conference on Neural Networks (IJCNN). 1–9.