KI-gestützte Lösungen für Medienarchive

In der schnell wachsenden digitalen Landschaft enthalten Medienarchive enorme Mengen an Audio- und Videodaten – beispielsweise aus Radio- und TV-Sendungen – die fortschrittliche Tools für eine effiziente Suche und den Abruf von Inhalten erfordern. Das Fraunhofer IAIS Audio Mining System ermöglicht schnelle und effiziente Suchanfragen nach gesprochenen Inhalten und spezifischen Sprechern. Dabei kommen verschiedene KI-basierte Technologien zum Einsatz: automatische Sprecher-Diarisierung (Segmentierung einer Datei in verschiedene Sprecherabschnitte), Sprechererkennung (Identifizierung bekannter Sprecher) und automatische Spracherkennung (ASR), d. h. die Transkription von gesprochenen Inhalten.

Diese Technologien bieten insbesondere Journalist*innen, die schnell Archive durchsuchen müssen, um Zitate aus früheren Sendungen zu finden. Diese Technologien bieten insbesondere Journalist*innen große Vorteile, die schnell Archive durchsuchen müssen, um Zitate aus vergangenen Sendungen zu finden. Zum Beispiel kann ein Journalist gezielt nach dem genauen Moment suchen, in dem ein*e Politiker*in zu einem bestimmten Thema gesprochen hat, ohne stundenlanges Videomaterial manuell durchsuchen zu müssen. Allerdings stoßen schlüsselwortbasierte Suchmethoden an ihre Grenzen, wenn es darum geht, allgemeine Themen oder semantisch verwandte Inhalte zu finden.

Die Archivsuche mit Generativer KI revolutionieren

Der Aufstieg der Generativen KI, insbesondere durch Tools wie ChatGPT, hat unsere Interaktion mit Technologie grundlegend verändert. Diese großen Sprachmodelle (LLMs) ermöglichen natürliche Sprachabfragen und bieten eine intuitive Benutzeroberfläche, um durch große Datenmengen zu suchen. Das Fraunhofer IAIS hat dies erkannt und einen Prototyp entwickelt, der generative KI mit seinem Medienarchiv-Suchsystem integriert. Dadurch entstand ein fortschrittliches Tool, das über einfache Stichwortsuchen hinausgeht.

Abb. 1: Das Fraunhofer IAIS Audio Mining System mit Sprechererkennung und Transkription.

Wie der Audio Mining LLM-Prototyp funktioniert: ASR-, LLM- und RAG-Technologien

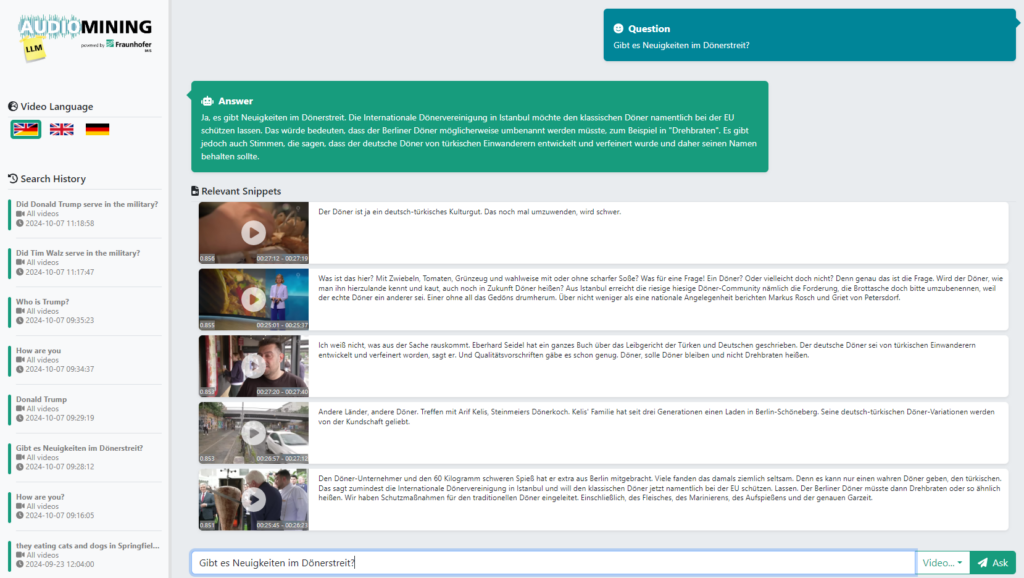

Der Audio Mining LLM-Prototyp kombiniert die KI-generierten Metadaten des Fraunhofer IAIS Audio Mining Systems (einschließlich automatischer Segmentierung von Mediendateien, Sprechererkennung und ASR-Transkription) mit einer semantischen Suchfunktion, die auf Retrieval-Augmented Generation (RAG) basiert. Das System können Nutzende detaillierte Fragen stellen, wie zum Beispiel „Gibt es Neuigkeiten im Dönerstreit?“. Das System ruft dann die relevantesten Segmente basierend auf semantischer Ähnlichkeit ab und ordnet diese mithilfe von Sentence Embeddings nach der besten Übereinstimmung absteigend an (für einen detaillierten Einblick, wie Embeddings funktionieren, empfiehlt sich der Blogbeitrag „Die Bedeutung von Worten durch Vektoren“).

Abb. 2: Der Audio Mining LLM-Prototyp beantwortet die Frage „Gibt es Neuigkeiten im Dönerstreit?“. Er gibt eine textuelle Antwort und listet die fünf relevantesten Segmente basierend auf semantischer Ähnlichkeit auf.

Das System nutzt ein großes Sprachmodell (LLM), um Antworten auf Basis relevanter Inhalte aus dem Archiv zu formulieren. Es minimiert das Risiko von „Halluzinationen“ – Situationen, in denen bei dem große Sprachmodelle falsche Informationen erzeugen –, indem es sicherstellt, dass alle Antworten auf verifizierbaren Daten beruhen. Dies macht es zu einer idealen Lösung für zuverlässige, faktenbasierte Medienarchiv-Suchen.

Anwendungen des Audio Mining LLM-Prototyps in der Medienbranche

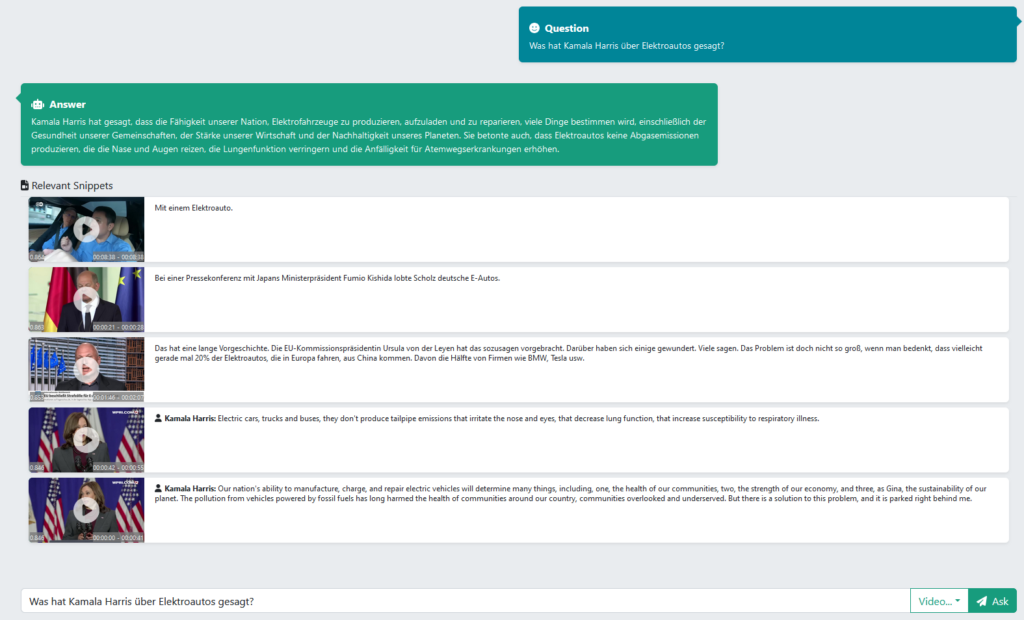

Traditionell ist es relativ einfach, über Stichwortsuchen herauszufinden, ob jemand ein bestimmtes Thema erwähnt hat, wie zum Beispiel alle Fälle zu finden, in denen Kamala Harris negative Kommentare über Elektroautos abgegeben hat. Der Audio Mining LLM-Prototyp bietet jedoch ein erhebliches Potenzial für verschiedene Anwendungen, insbesondere in der Medienbranche. So können investigative Journalist*innen das System nutzen, um schnell spezifischen Aussagen oder Meinungen öffentlicher Personen zu finden, etwa wann Kamala Harris negativ über Elektroautos gesprochen hat – etwas, das über eine einfache Stichwortsuche hinausgeht.

Das System des Audio Mining LLM-Prototyp transkribiert jedes gesprochene Wort, sodass selbst subtile Meinungen und Details erfasst werden können, ohne sich auf manuell annotierte Metadaten verlassen zu müssen. Der RAG-Ansatz stellt sicher, dass relevante Segmente aus dem Archiv abgerufen werden, wodurch Einblicke gewonnen werden, die traditionelle Suchmethoden möglicherweise übersehen würden.

Eine weitere Anwendung liegt in öffentlichen Video-on-Demand-Plattformen, auf denen Nutzer*innen von einem System profitieren könnten, das nicht nur nach Titeln oder Genres sucht, sondern auch personalisierte Empfehlungen basierend auf individuellen Vorlieben oder spezifischen Fragen bietet. Dies könnte das Benutzererlebnis erheblich verbessern und neue Möglichkeiten eröffnen, mit Medienarchiven zu interagieren.

Herausforderungen und Grenzen des aktuellen Prototyps

Obwohl der Audio Mining LLM-Prototyp vielversprechende Ergebnisse zeigt, bleibt er ein Prototyp mit Verbesserungspotenzial. Eine der größten Herausforderungen liegt in der Segmentierung von Video- und Audiodaten, bei der kurze, irrelevante Segmente zurückgegeben werden können, was die Nützlichkeit der Suchergebnisse verringert. Künftige Verbesserungen in Contextual Retrieval-Systemen könnten diese Einschränkung beheben und die Qualität und Relevanz der Segmente erhöhen.

Abb. 3: Der Audio Mining LLM-Prototyp liefert teilweise irrelevante Segmente zur gestellten Frage, wie zum Beispiel die ersten Segmente in diesem Screenshot.

Eine weitere aktuelle Einschränkung ist die Unfähigkeit des Systems, quantitative Analysen durchzuführen. Der Prototyp kann beispielsweise nicht zählen, wie oft ein bestimmtes Thema von einer Person erwähnt wurde, oder eine umfassende Liste aller Erwähnungen bereitstellen. Zukünftige Updates könnten das RAG-System feinjustieren, um komplexere analytische Aufgaben zu bewältigen, einschließlich der Zählung von Vorkommnissen und der Erstellung von Listen basierend auf dem gesamten Archiv.

Zukünftige Entwicklungen: Erweiterung der Audio-Mining-Fähigkeiten mit LLMs

Nach seinem erfolgreichen Debüt als Proof of Concept auf der International Broadcasting Convention 2024 (IBC) hat der Audio Mining LLM-Prototyp positives Feedback aus der Medienbranche erhalten. Zukünftige Entwicklungen werden sich auf maßgeschneiderte Lösungen für Anwendungsfälle wie quantitative Medienanalyse, Nachrichtenverifizierung und verbesserte Suchschnittstellen für Video-on-Demand-Dienste konzentrieren.

Im Fraunhofer IAIS erforschen wir kontinuierlich, wie RAG-Technologien an die spezifischen Bedürfnisse der Brachen angepasst werden können, um die Leistungsfähigkeit und Benutzerfreundlichkeit von Medienarchiven für Journalist*innen, Forschende und die Öffentlichkeit zu verbessern. Mehrere RAG-bezogene Projekte sollen bis Ende des Jahres abgeschlossen und die Ergebnisse im ML-Blog des Lamarr-Instituts nach und nach veröffentlicht werden. Bleiben Sie also dran!